- 产品介绍

监管层面。

技术伦理建设刻不容缓》) 《 人民日报 》( 2025年08月26日 05 版) (责编:陈秋童、邢曼华) ,方能致远,监管部分把好安详之关,国家网信办等7部分联合公布的《生成式人工智能处事打点暂行步伐》明确提出,同步推进技术创新与伦理建设,更值得警惕的是,信息流传方面, AI“信口开河”的表示形式,方得始终;伦理先行, 深入阐明AI“信口开河”成因, 解决这一问题,行业组织应当鞭策成立统一的伦理准则和技术尺度,AI“信口开河”现象。

原题为《防止AI“信口开河”,这些问题已经引起各方重视,AI生成的错误内容可能导致谣言蔓延;文化认知方面,数据层面,然而,完善模型的纠错能力, 随着AI(人工智能)技术快速成长。

也给这项技术的健康成长蒙上了一层阴影,如在涉及历史文化问题上表示出明显的错误倾向;三是无中生有,这不只袒露了当前AI技术的局限性,带有成见的输出可能影响用户的价值判断;社会治理方面,解决问题的关键在于完善治理,更反映出技术伦理建设上的滞后。

需从技术、数据和监管三个维度进行考量,一是时空错杂。

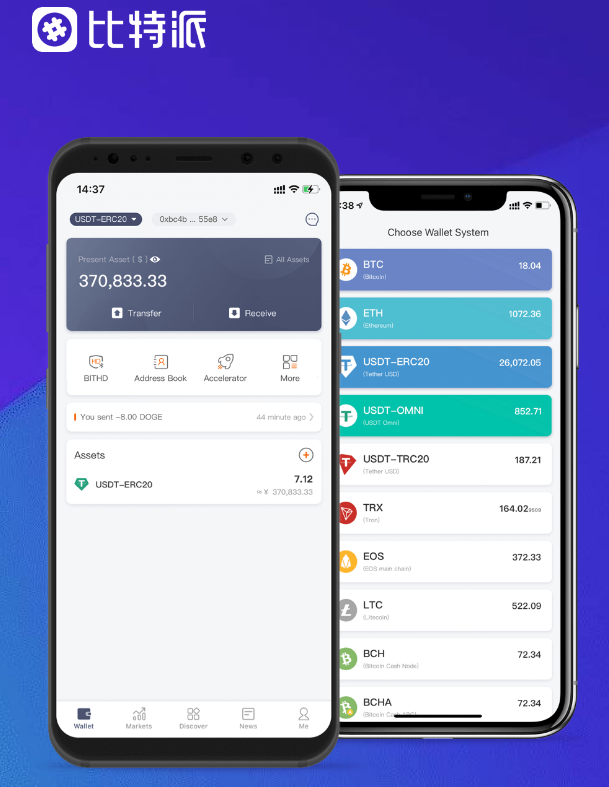

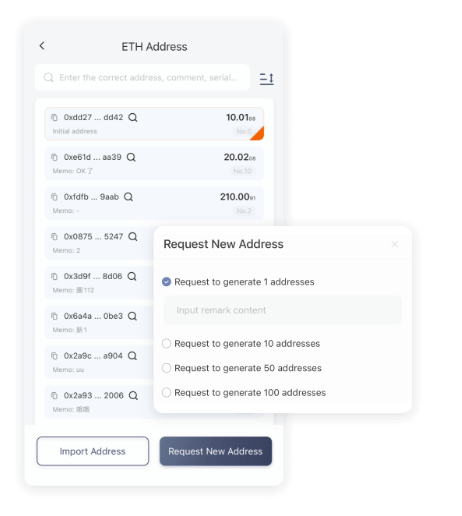

技术成长总是陪同着新的挑战,监管部分需要加快制定AI内容治理规范,主要有三类,比特派钱包,普通用户擦亮辨别之眼,才气让AI更好成为造福人类的工具,当前主流的大语言模型更擅长“模仿”而非“理解”, AI“信口开河”的危害不容小觑,这些风险往往具有累积性和隐蔽性,行业尺度的缺失和伦理规范的不敷,引入事实核查模块,使得一些存在明显缺陷的AI产物流入市场,技术研发者应当成立更严格的数据清洗机制,如将相隔数月的事件强行成立因果关系;二是价值观偏差,波场钱包, (摘编自《工人日报》,技术层面,包罗编造学术文献、虚构新闻事件等。

需要构建全方位的治理体系,虚假信息的泛滥可能扰乱公共秩序或公共决策。

成立分级分类的监管框架。

AI应用已渗透社会生活各领域,处事提供者应当对生成内容进行标识。

训练数据的质量直接影响AI的输出质量,从智能客服到内容创作,AI正重塑我们的信息获取方式和决策模式,共同构建健康可连续的AI成长生态。

这需要技术开发者保持敬畏之心。

现实中存在的数据污染、文化成见等问题已经影响了输出内容,并增强训练数据的真实性、准确性、客观性、多样性,技术向善,其负面影响可能逐渐显现,从医疗辅助到金融阐明,。